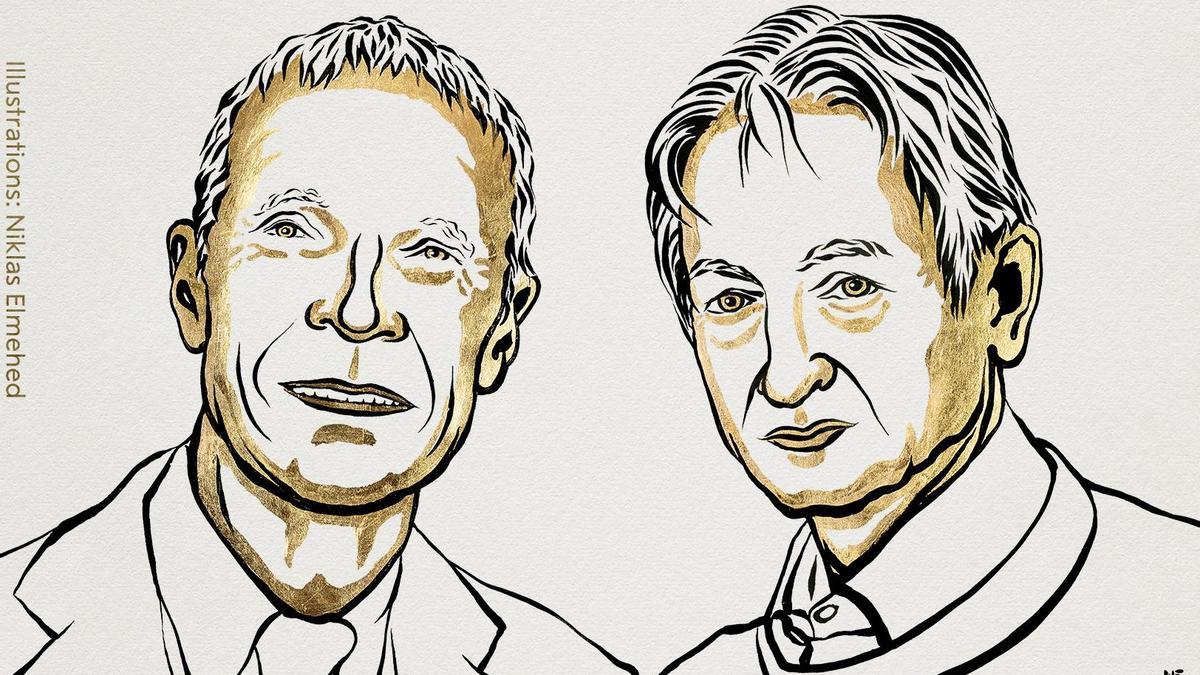

La Real Academia Sueca de Ciencias ha otorgado el premio a John J. Hopfield y Geoffrey E. Hinton “por descubrimientos e invenciones fundamentales que permiten el aprendizaje automático con redes neuronales artificiales”.

Hemeroteca – Nobel de Física 2023 por las aportaciones de la “física de los attosegundos”

El comité del Nobel de Física ha otorgado el premio de este año a John Hopfield y Geoffrey E. Hinton por utilizar herramientas de la física para desarrollar métodos que son la base del potente aprendizaje automático actual. En concreto, Hopfield creó una memoria asociativa que puede almacenar y reconstruir imágenes y otros tipos de patrones en los datos, mientras que Hinton inventó un método que puede encontrar propiedades de forma autónoma en los datos y, por lo tanto, realizar tareas como identificar elementos específicos en imágenes.

“El trabajo de los galardonados ya ha sido de gran utilidad. En física, utilizamos redes neuronales artificiales en una amplia gama de áreas, como por ejemplo en el desarrollo de nuevos materiales con propiedades específicas”, afirma Ellen Moons, presidenta del comité que ha concedido el premio y que considera auqe ambos han ayudado a sentar las bases para la revolución del aprendizaje automático que comenzó alrededor de 2010.

John Hopfield creó una estructura que puede almacenar y reconstruir información. Geoffrey Hinton inventó un método que puede descubrir de forma independiente propiedades en los datos y que se ha vuelto importante para las grandes redes neuronales artificiales que se utilizan actualmente.

En la rueda de prensa de presentación del premio, Hinton ha reconocido que uso la herramienta ChatGPT y la encuentra “muy útil”, aunque no se fía de sus respuestas al cien por cien porque puede tener “alucinaciones”. La presidenta del comité encuentra difícil de imaginar que herramientas como ChatGPT se hubieran podido desarrollar si no hubiera sido por el trabajo pionero de los premiados.

Las redes que “piensan”

Aunque los ordenadores no pueden pensar, las máquinas pueden imitar funciones como la memoria y el aprendizaje. Los laureados de este año en física han contribuido a que esto sea posible. Utilizando conceptos y métodos fundamentales de la física, han desarrollado tecnologías que utilizan estructuras en redes para procesar información.

El aprendizaje automático se diferencia del software tradicional, que funciona como una especie de receta. El software recibe datos, los procesa según una descripción clara y produce los resultados, de forma similar a cuando alguien recoge ingredientes y los procesa siguiendo una receta para producir un pastel. En cambio, en el aprendizaje automático, el ordenador aprende con ejemplos, lo que le permite abordar problemas que son demasiado vagos y complicados para ser gestionados con instrucciones paso a paso.

Una red neuronal artificial procesa información utilizando toda la estructura de la red. La inspiración surgió inicialmente del deseo de comprender cómo funciona el cerebro. En la década de 1940, los investigadores habían comenzado a razonar sobre las matemáticas que subyacen a la red de neuronas y sinapsis del cerebro. Otra pieza del rompecabezas provino de la psicología, gracias a la hipótesis del neurocientífico Donald Hebb sobre cómo se produce el aprendizaje porque las conexiones entre neuronas se refuerzan cuando trabajan juntas.

Más tarde, a estas ideas les siguieron intentos de recrear el funcionamiento de la red cerebral mediante la construcción de redes neuronales artificiales como simulaciones por ordenador. En ellas, las neuronas del cerebro se imitan mediante nodos a los que se les asignan valores diferentes, y las sinapsis se representan mediante conexiones entre los nodos que pueden hacerse más fuertes o más débiles. La hipótesis de Donald Hebb todavía se utiliza como una de las reglas básicas para actualizar las redes artificiales mediante un proceso llamado entrenamiento.

A partir de la biología

A finales de los años 60, Hopfield ya había utilizado su formación en física para explorar problemas teóricos de biología molecular. Cuando lo invitaron a una reunión sobre neurociencia, se topó con una investigación sobre la estructura del cerebro. Lo que aprendió le fascinó y empezó a pensar en la dinámica de las redes neuronales simples. Cuando las neuronas actúan juntas, pueden dar lugar a características nuevas y poderosas que no son evidentes para alguien que solo observa los componentes separados de la red.

En 1980, Hopfield dejó su puesto en la Universidad de Princeton y aceptó una cátedra de química y biología en Caltech (Instituto Tecnológico de California) donde encontró inspiración para su comprensión de cómo los sistemas con muchos componentes pequeños que trabajan juntos pueden dar lugar a fenómenos nuevos e interesantes. En particular, le benefició haber aprendido sobre materiales magnéticos que tienen características especiales gracias a su espín atómico, una propiedad que convierte a cada átomo en un pequeño imán.

Cuando Hopfield publicó su artículo sobre la memoria asociativa, Geoffrey Hinton trabajaba en la Universidad Carnegie Mellon de Pittsburgh (Estados Unidos). Hinton utilizó la red de Hopfield como base para una nueva red que utiliza un método diferente: la máquina de Boltzmann, basada en las herramientas de la física estadística. Esta herramienta puede aprender, no a partir de instrucciones, sino de ejemplos. El entrenamiento también afecta la probabilidad de generar nuevos patrones que se asemejen a los ejemplos con los que se entrenó la máquina, de modo que una máquina de Boltzmann entrenada puede reconocer rasgos familiares en información que no ha visto previamente.

Según el comité del Nobel, el desarrollo que estamos presenciando en la actualidad ha sido posible gracias al acceso a grandes cantidades de datos que se pueden utilizar para entrenar redes y al enorme aumento de la potencia informática. Las redes neuronales artificiales actuales suelen ser enormes y están formadas por muchas capas. Se denominan redes neuronales profundas y la forma en que se entrenan se denomina aprendizaje profundo.

PODCAST | Malasaña y 40 kilos de cocaína: un montaje policial para destruir a Podemos

PODCAST | Malasaña y 40 kilos de cocaína: un montaje policial para destruir a Podemos